W praktyce samsung galaxy ai to zestaw funkcji, które pomagają poprawić kadr, usunąć rozpraszające elementy i wyciągnąć więcej z ujęcia już po zrobieniu zdjęcia. W fotografii mobilnej nie chodzi więc o sam marketing, tylko o to, czy telefon naprawdę oszczędza czas i poprawia efekt bez przerzucania pracy na komputer. Poniżej rozpisuję, które narzędzia faktycznie mają sens, jak z nich korzystać i kiedy lepiej zachować ostrożność, zwłaszcza jeśli zdjęcie ma trafić do druku albo do bardziej wymagającej publikacji.

Najważniejsze rzeczy, które warto wiedzieć od razu

- Galaxy AI w fotografii to przede wszystkim edycja po wykonaniu zdjęcia, a nie „magiczny aparat”, który zrobi wszystko za Ciebie.

- Najbardziej użyteczne są narzędzia do usuwania obiektów, prostowania kadru, uzupełniania braków i poprawy portretów.

- Najlepsze efekty daje zdjęcie, które już na starcie ma dobrą ekspozycję, ostrość i trochę wolnej przestrzeni wokół głównego obiektu.

- Wiele funkcji działa na wybranych modelach i zwykle wymaga internetu oraz konta Samsung.

- Przy edycji generatywnej trzeba uważać na szczegóły, bo algorytm bywa świetny w tle, ale mniej pewny przy włosach, szkłach i drobnych fakturach.

- Jeśli zdjęcie ma iść do druku, warto zachować oryginał, bo część edycji kończy się plikiem o niższej rozdzielczości niż źródło.

Co te funkcje naprawdę zmieniają w zdjęciach z telefonu

Najprościej patrzę na to tak: AI w Galaxy nie zastępuje aparatu ani dobrego światła, tylko daje drugi etap pracy nad zdjęciem. Aparat ma uchwycić scenę, a algorytmy mają pomóc z kadrowaniem, usuwaniem obiektów, uzupełnianiem braków i poprawą portretu. Dla osoby fotografującej telefonem to ważne, bo wiele ujęć da się uratować w 20 sekund zamiast powtarzać sesję.

Największą różnicę widać wtedy, gdy fotografujesz w ruchu, w tłumie albo przy świetle, którego nie da się już poprawić. W takich sytuacjach AI nie robi cudów, ale często zamienia zdjęcie „do kosza” w materiał, który da się normalnie opublikować.

Ja traktuję te funkcje bardziej jako sprytne narzędzia do obróbki niż jako obietnicę idealnego zdjęcia bez wysiłku. To prowadzi do pytania, które narzędzia faktycznie dają największy efekt w codziennej pracy z galerią.

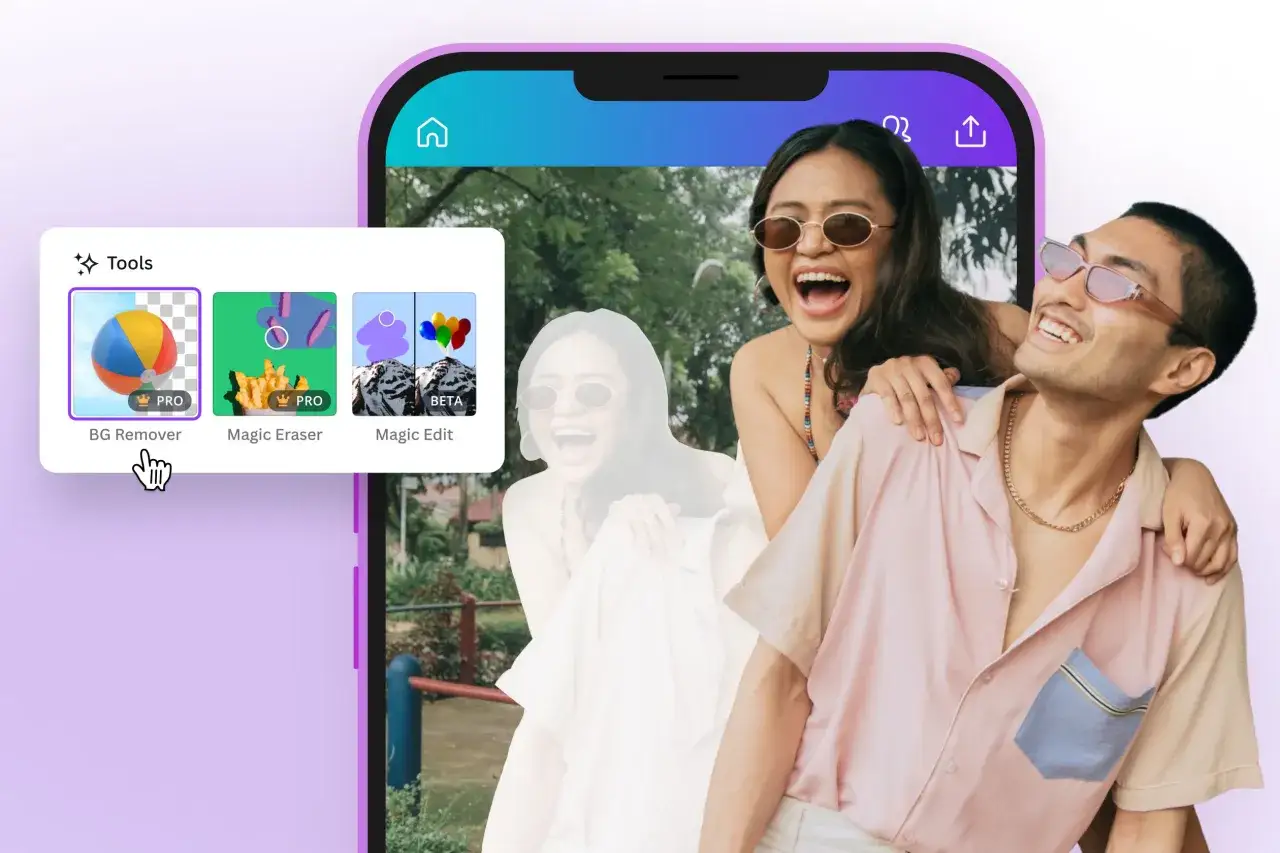

Jakie narzędzia z galerii są naprawdę warte uwagi

W praktyce z całego zestawu najbardziej liczą się funkcje, które oszczędzają czas i nie zmuszają do nauki skomplikowanej edycji. Poniżej zestawiam te, z którymi najczęściej miałem do czynienia w kontekście fotografii mobilnej.

| Funkcja | Co robi | Kiedy ma największy sens | Na co uważać |

|---|---|---|---|

| Generative Edit | Przesuwa, usuwa albo dorysowuje elementy i uzupełnia brakujące fragmenty tła. | Turysta w tle, śmietnik na chodniku, przypadkowy cień, zbędny znak drogowy. | Może zniekształcić faktury i szczegóły, a wynik bywa zapisany w niższej rozdzielczości. |

| Edit suggestion | Podpowiada szybkie poprawki, takie jak kadrowanie, remaster, usunięcie cieni lub refleksów. | Gdy chcesz szybko uporządkować zdjęcie bez ręcznego grzebania w ustawieniach. | Bywa zbyt agresywne, jeśli scena już wygląda naturalnie. |

| Best Face | Wybiera najlepszy wyraz twarzy z serii ujęć z Motion Photo. | Zdjęcia grupowe, rodzinne selfie, ujęcia dzieci, gdzie ktoś zawsze mruga. | Działa tylko w określonym trybie i nie zastąpi dobrego momentu w kadrze. |

| Portrait Studio | Przerabia selfie na stylizowany portret, na przykład komiksowy albo malarski. | Zdjęcia profilowe, kreatywne wersje do social mediów, lekka zabawa formą. | To bardziej efekt artystyczny niż neutralna obróbka fotograficzna. |

| Sketch to image | Rozszerza prosty szkic o gotowy element wizualny. | Makiety, koncepty, kreatywne dodatki do zdjęć i materiałów wizualnych. | Słabsze jako narzędzie do „prawdziwej” fotografii, mocniejsze w kreatywnym eksperymencie. |

Jeśli miałbym wskazać trzy funkcje najważniejsze dla zwykłego użytkownika, byłyby to: usuwanie obiektów, sugestie edycji i wybór najlepszego wyrazu twarzy. Reszta jest przydatna, ale częściej działa jako dodatek niż jako codzienny ratunek. Z takiego zestawu łatwo przejść do praktyki, więc pokażę teraz kilka typowych sytuacji krok po kroku.

Jak użyć tych narzędzi w codziennych kadrach

Najwięcej sensu ma nie sama lista funkcji, ale konkretny scenariusz. Właśnie wtedy widać, czy AI rzeczywiście pomaga, czy tylko dokłada kolejną warstwę do i tak dobrze zrobionego zdjęcia.

Zdjęcie z przypadkową osobą w tle

To klasyczny przypadek: świetny kadr, ale obok przechodzi ktoś w jaskrawej kurtce albo w tle stoi obcy samochód. W Galerii wybieram zdjęcie, otwieram Photo Assist, zaznaczam obiekt do usunięcia i sprawdzam, czy algorytm dobrze wypełnił tło. Jeśli detal jest prosty, efekt bywa bardzo dobry; jeśli tło ma wzór, np. cegły albo gałęzie, patrzę na łączenia dwa razy dłużej.

Selfie lub zdjęcie grupowe

Tu najlepiej sprawdza się Best Face, bo jeden mrugający uczestnik potrafi zepsuć całe ujęcie. Zwykle trzymam się zasady, że najpierw robię serię, a dopiero potem wybieram najlepsze miny. W zdjęciach grupowych to naprawdę skraca pracę, zwłaszcza gdy zależy mi na szybkim publikowaniu zdjęcia, a nie na ręcznym składaniu kilku wersji.

Portret do internetu albo zdjęcie profilowe

W tym przypadku najczęściej sięgam po Portrait Studio albo delikatniejsze poprawki w sugestiach edycji. Jeśli potrzebuję efektu bardziej naturalnego, wybieram tylko lekki remaster, korektę cieni i prosty crop. Jeśli tworzę wersję stricte kreatywną, stylizacja portretu ma sens, ale od razu zakładam, że nie jest to już klasyczne zdjęcie dokumentalne.

Przeczytaj również: Sony Alpha A100 - Czy ten klasyk z matrycą CCD wciąż ma sens?

Fotografia produktu lub wnętrza

Przy produktach i wnętrzach AI jest przydatna głównie do porządkowania kadru, usuwania odbić albo drobnych przeszkadzajek. Nie używałbym jej jednak do „tworzenia” szczegółów, które mają znaczenie informacyjne, na przykład faktury materiału, kształtu elementu albo realnego koloru. To są kadry, w których użytkownik oczekuje przede wszystkim wiarygodności.

Takie scenariusze pokazują, że AI najlepiej działa wtedy, gdy poprawia zdjęcie, a nie gdy próbuje całkowicie je wymyślić od nowa. I właśnie w tym miejscu warto przejść do ograniczeń, bo one decydują o tym, kiedy efekt będzie naturalny, a kiedy przesadzony.

Kiedy algorytm pomaga, a kiedy zaczyna przeszkadzać

Najczęstszy błąd użytkowników polega na tym, że oczekują od AI pełnej naprawy słabego zdjęcia. To zwykle nie działa. Algorytm lepiej radzi sobie z tym, co jest niejednoznaczne w tle, niż z tym, co stanowi główny temat kadru.

Najbardziej ryzykowne są miejsca, gdzie pojawia się dużo drobnych detali: włosy, okulary, przezroczyste szkło, metaliczne odbicia, gałęzie, siatki, wzory na ubraniach. Tam łatwo o artefakty, czyli sztuczne, nienaturalne fragmenty obrazu. Widać je zwykle dopiero po powiększeniu, dlatego zawsze sprawdzam zdjęcie przed zapisaniem kopii.

Druga rzecz to wiarygodność. Jeśli zdjęcie ma służyć jako dokument, materiał prasowy, fotografia produktu albo ujęcie do portfolio, które ma pokazać realny stan rzeczy, trzeba być ostrożnym. AI świetnie nadaje się do poprawiania estetyki, ale nie powinna fałszować tego, co ma znaczenie merytoryczne.

Wreszcie jest jeszcze kwestia druku. Przy edycji generatywnej część plików bywa zapisywana w rozdzielczości do 12 MP, więc przy większych odbitkach albo mocnym kadrowaniu lepiej nie wyrzucać oryginału. To prowadzi do kolejnego, bardzo praktycznego tematu: jakie warunki muszą być spełnione, żeby wszystko działało tak, jak trzeba.

Co trzeba mieć w telefonie i w ustawieniach

Według Samsunga, wiele funkcji Photo Assist działa na wybranych telefonach i tabletach z Androidem 14 oraz One UI 6.1 lub nowszym, a do części edycji potrzebne są także konto Samsung i połączenie z internetem. To ważne, bo w praktyce nie każdy model ma identyczny zestaw narzędzi, nawet jeśli wizualnie interfejs wygląda podobnie.

Warto też wejść w ustawienia i sprawdzić ścieżkę Ustawienia > Galaxy AI > Photo Assist, jeśli dana opcja nie pojawia się od razu w galerii. Czasem funkcje są dostępne, ale po prostu nie są jeszcze aktywowane albo zostały ukryte głębiej w menu.

Istotna jest również kwestia licencji i kosztów. Podstawowe funkcje Galaxy AI są opisywane jako bezpłatne, ale warunki mogą się różnić w zależności od modelu, regionu i usług firm trzecich. Ja zawsze traktuję to jako argument za tym, żeby przed zakupem telefonu sprawdzić konkretną listę funkcji dla danego wariantu, a nie tylko ogólny slogan na stronie produktu.

Gdy już wiesz, co działa i od czego to zależy, można przejść do rzeczy, która ma największy wpływ na końcowy efekt: do samego fotografowania. Dobre AI pomaga, ale dobry materiał wejściowy pomaga jeszcze bardziej.

Jak fotografować tak, żeby później łatwo to poprawić

Najlepsze zdjęcia do obróbki robi się wtedy, gdy zostawia się algorytmowi trochę przestrzeni. Dosłownie. Jeśli obiekt jest przycięty przy samej krawędzi, późniejsze przesunięcie albo uzupełnienie tła będzie wyglądało gorzej niż wtedy, gdy wokół tematu zostawisz margines.

Druga zasada jest prosta: pilnuj światła i stabilności. AI potrafi poprawić kadr, ale nie naprawi całkowicie poruszonego zdjęcia ani fatalnej ekspozycji. Im mniej szumu, przepaleń i rozmycia na wejściu, tym lepszy materiał wyjściowy po obróbce.

- Rób zdjęcia z niewielkim zapasem kadru, zwłaszcza przy portretach i zdjęciach ulicznych.

- Unikaj wciskania głównego obiektu w sam narożnik obrazu.

- W zdjęciach grupowych włącz tryb, który zapisuje serię ujęć, żeby później łatwiej wybrać najlepsze miny.

- Przy szkłach, lustrach i metalach zmieniaj kąt, zamiast liczyć, że AI usunie każdy refleks.

- Nie podbijaj wszystkiego od razu do maksimum; delikatna korekta wygląda bardziej naturalnie niż mocny efekt „po przeróbce”.

Ja lubię o tym myśleć tak: aparat zbiera materiał, a AI robi kosmetykę. Jeśli od razu zadbasz o kadr, światło i ostrość, końcowa edycja będzie krótsza i bezpieczniejsza. Została jeszcze jedna rzecz, która szczególnie interesuje czytelników korzystających ze zdjęć poza ekranem telefonu.

Co warto zapamiętać przed publikacją i drukiem

Jeśli zdjęcie ma trafić tylko do mediów społecznościowych, można pozwolić sobie na więcej swobody. Jeśli jednak ma iść do albumu, portfolio albo do druku, trzeba być bardziej konserwatywnym. W fotografii mobilnej największy problem nie polega dziś na tym, że AI nie działa, tylko na tym, że działa aż za dobrze i potrafi ukryć to, co potem wyjdzie na większym formacie.

Dlatego zawsze zachowuję oryginał i porównuję go z wersją po edycji. Zwracam uwagę nie tylko na estetykę, ale też na ostrość, faktury, kolory skóry i drobne linie w tle. Gdy coś wygląda dobrze tylko na małym ekranie, zwykle nie będzie wyglądało równie dobrze po wydruku.

Jeśli miałbym zostawić jedną praktyczną zasadę, byłaby bardzo prosta: najpierw zrób uczciwie dobre zdjęcie, potem użyj AI tylko do usunięcia tego, co naprawdę przeszkadza. Właśnie wtedy technologia daje najlepszy efekt, a fotografia mobilna nadal wygląda naturalnie, a nie sztucznie dopieszczona.